今天看到一款遊戲,是可愛風格的放置型遊戲,結果是中資背景的~~

我不大了解遊戲的安全性,不曉得這種放置型遊戲,要開後門是不是相對容易啊?

(想起來之前有研究過 reverse TCP tunnel,只要一個 RCE 漏洞後面就可以在 Linux 開後門了,Windows 不曉得又是怎樣)

from g0v.social

Content from https://g0v.social/@jimyhuang

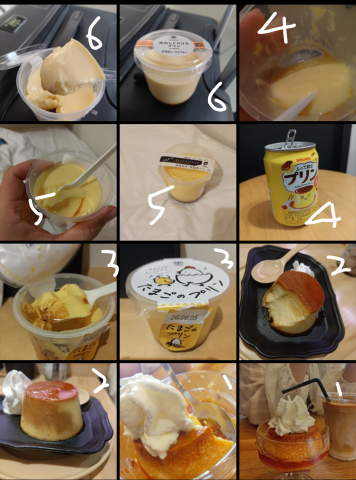

#布丁獵人 第三彈

這次在獵人じょしゅ的協助下,意外的又考察了不少布丁

1. 大阪咖啡店的手工布丁,僅供照片聞香、不在考察範圍

2. 壽司郎布丁,極度扎實的布丁體,但有種粉粉的口感,個人無法接受

3. TORAKU推出「雞蛋布丁」,在Lawson 買到,是這次評比的第一名,雞蛋味道香濃,口感扎實又不失軟Q,糖漿是我喜歡的帶一點苦味焦糖口味,大約150元日幣,非常超值。

4. Sangaria 在販賣機買到罐裝布丁飲料,要搖五下以上,倒出來看是糊狀的布丁。太獵奇列入考察範圍,最後喝了有點後悔:像是統一布丁絞碎稀釋3倍的化工水感布丁(但額外加糖),但是是真的可以喝的布丁沒錯啦...

5. 車站超市買的「成城石井」布丁,非常好吃,大概比 Toraku 好吃一點點,不過一顆是400元日幣,昂貴好吃的布丁

6. 機場全家買到的布丁,全家製品,吃起來是個牛奶味濃厚,布丁體偏軟嫩的傢伙,個人偏好雞蛋口味重或化工口味重,因此落選。

本次獵人評選:Lawson的 Toraku 出品雞蛋布丁,上面有可愛的母雞小雞手繪插畫,非常推薦。

這次在 teamLab Biovortex Kyoto 的展覽,雖然沒有上次我在 teamLab Borderless Tokyo 那樣的感動,不過還是有非常驚艷的體驗。

整體來說,設計動線有一點借鏡 Borderless 那樣沒有固定動線的設計,讓觀眾自行探索,這點滿加分的。

體驗的部分,原本在一樓會覺得主題和光影動畫呈現太過單一,沒想到還有好幾層可以探索,一開始以為一下就結束的,最後我們還是逛到4個多小時才離去,作品非常豐富。

唯一可惜的是音樂部分。有很多場景藝術裝置是很適合不同的風格的音樂,但他貫穿整體都有那種久石讓的調調,總覺得音樂還是太強調自然感了,算是重視音像的我頗無法適應的一個點...

來京都體驗觀光客大排長龍的酒吧,是個以魔術為主題,在京都一級戰區的 Bar L'Escamoteur

一共點了三杯調酒,都以菜單上的 "Stage Magic" 為主,也就是視覺系,有煉金術、火焰、砰砰、煙霧、爆破等效果,影片中的是爆破效果。

開始之前因為閃光太強,他們會發給吧台前面一人一個烏漆抹黑的蛙鏡要你戴上,確定你戴上才玩這套遊戲,也是滿週到的體驗!!

這次嘗試織布體驗,真的滿好玩也有成就感,大約兩個小時,就可以做出自己想要的材質和花色,現場也很多素材顏色可以選擇,有選擇困難的人請小心進入!

然而對社工群體的集體反應,一些感想:

.台灣的刑法一般來說只能起訴自然人不是法人。

.檢察官的職責下,一個命案不起訴這樣的關係人的話,我覺得反而會是包庇。

.法官在本案只能看起訴對象的案例來判,從司法上其實是無法尋求制度改善的。例如,衛福部+兒盟的收出養制度,這要從政府和機構去改善。

.訴求制度改善,但一邊抨擊司法爛掉,還是檢察官濫訴,還是法官素養不佳的,我覺得在社會觀感上不會有正向效果。

.這樣導致,社工群體透過剴剴案的任何訴求,都會被本案拖累,讓自身的(專業)形象下降,這波改革動能引爆的很突然,缺少策略

.媒體跟隨著兒虐命案放大報導,警方上銬社工,網路群體無差別的謾罵,一線社工承受很大的壓力,到現在要用這個判決的結果作為出口,感覺是個非常悲劇的循環... 但還是希望社福界的優秀單位不要噤聲,這樣民眾才對社工專業維持信心。

我看到多多益善 Podcast 有好好找法律人來解說判決,也是發聲很好的案例(底下是逐字稿) https://rightplus.org/2026/05/05/kaikai-podcast-2/

有時候在看網路事件,總覺得說出口的不是給那些漫罵的人看的,是說給沒有表達的人看的。

其實在前兩週就看完判決書了,雖然有紀錄但不想急著在鋒頭上發文,現在回頭看後,覺得這些在意的點還是可以拿出來看看:

.被告沒有跟家屬做任何調解或賠償,甚至表達意願,亦無認罪,我覺得是刑期超出預期的原因(符合之前我的猜測,但我覺得這也是被告的權利)

.兒盟真的很有事,尤其是整個自行招募、托給審核過保母的制度由他們建立,甚至還用這個制度得到政府特許,但管理上是沒有讓執行人員得知自己承擔多大的責任,和確切的風險評估,和備援人員,但整個社工圈的討論,論述兒盟應負的責任消失了(這點我很不解,有誤的話歡迎指正)

.很多謠傳的「溢奶說」來把被告說成邪惡的樣貌可能是個問題,因法院有證實被告事後在記錄撰寫中,文字如實表達兒虐可能,沒有隱瞞意圖(也是偽造文書無罪的主因之一)。

.綜合這些來看,我很贊成被告上訴,也希望他最終能獲得他想要的清白。

最近沉迷於《The Alters》(多重人生),其實滿好玩的。而且買了之後才發現,是我喜歡的遊戲公司 11 bit studio 出品。

之前玩他們公司的 The War of Mine、Frostpunk 其實都是滿虐的策略/生存遊戲,結合了人權、勞工權益等有趣的議題之外,也都非常好玩,生存起來頗有成就感。

這次 The Alters ,很驚艷他們製作的 3D 視覺風格,也是之前在玩 p5js 一直想要嘗試繪製的效果。

當然,遊戲也「不免俗」的融入了各種想得到的複製人議題,遊戲也算頗有挑戰,讓我想起以前在Frostpunk 要泯滅人性剝奪自由、勞權,才有辦法讓鎮民生存下去的記憶..

整體而言,如果喜歡科技主題的,算是滿推薦的一款小品(我還沒完成,但應該不會花太久時間吧?)