評估取代 Google Analytics 時,看到有趣的東西:

https://github.com/th0th/poeticmetricGolang

PostgreSQL

Clickhouse

AGPL3.0自行架設的話要自己實現前端追蹤,不使用 Cookie 追蹤,沒有 Session 概念,只用 Hash 來看是否為特定使用者(IP/User Agent)

其實說回來,我也只是想知道 Total Page View 在特定幾個網頁而已...

from g0v.social

Content from https://g0v.social/@jimyhuang

Reddit 上 Linux Gaming 上,列了一堆 Open Source 遊戲

https://www.reddit.com/r/linux_gaming/comments/14s3716/what_is_your_favourite_open_source_games/

結合音像藝術... 我自己是滿可以的,剛好很久沒看展覽,一次看這些藝術家的展出補血一下

但不知道科技社群是否賞臉賞時間參與啊

https://ocftw.kktix.cc/events/ocf-summer-2023

https://news.ycombinator.com/item?id=36605130

Hacker News 上有個譬喻/提問:如果去咖啡店看到報紙頭條,沒有細讀內容就跟朋友討論,咖啡店要付費給這個討論嗎?又如果咖啡店播放音樂學要公播授權費,為何不用付費給媒體呢?

底下延伸的譬喻:

FB / Google 像是在咖啡店門口擺試喝拿鐵叫你不一定要進門;又有人補充,他們是載一卡車的人去門口試喝底下延伸的提問:

我們真的需要 local news 嗎?影響 local news 的是 FB 搶市還是大型媒體覆蓋地方言論?--

我自己是覺得,有些媒體寧願付廣告費用給 FB,也不願弄個 RSS,也是讓整個生態越陷越深不健康的一環,至少花一部分資源投資在基礎觀眾,再追求演算法觀眾吧?不過我的確是屬於不懂媒體經營的。

3/3

立法脈絡的討論,下面文章整理的很好,TL;DR,媒體業嚴重萎縮,因為觀眾滑過社群媒體後就不盡然點擊,直接看下方的討論預覽甚至直接用標題開始討論,導致原本廣告下在傳統媒體,過去十年廣告資源轉變成下在社群媒體,而媒體業資源萎縮下,又得在平台上彼此競爭,變相為幫社群媒體打工。長久之下傷害了產業,所以說是媒體存亡討論不為過。

比起來,更嚴重的是傷害了人民知的權力,進而對民主造成不好的影響(而且現在我們都見證到了)。

https://vocus.cc/article/648e898dfd89780001b91ead講到加拿大政府應對 FB 不從,只能祭出公營企業不下 Meta 廣告,新聞也提到,這個決策沒有影響該政黨下廣告。該執政政黨之後還是每月下廣告15,000 在社群媒體。

在 Hacker News 上的討論,就有人「好心」的說這個很有趣,不過下面網友回覆很好:這其實就是個民主政府看來非常正常適當的現象,稅金本來就該跟黨派分開想,黨派使用的是私營的錢,而政府政策使用的是人民的稅金,撤廣告撤人民稅金,以抵抗 FB 不從人民提出的法案,看來很合理。

2/3

https://news.ycombinator.com/item?id=36603263

加拿大政府針對社群媒體付費給媒體的法案 6/22 上路,其中 FB 和 Google 紛紛做出了回應打算下架新聞網站的連結,看政府要怎麼執行法案。

從新聞本身,到 Hacker News 下的留言討論,都有滿多看點,可以說媒體未來存亡討論。

新聞中值得看的是一家企業看待自己影響社會時,打算怎麼負起責任,尤其還是民主社會透過立法程序討論多年立出來的法案。

FB 是直接開始擋新聞,也不跟政府和任何新聞業者交涉(之前在澳洲也幹過一次),因此被批評為不負責、不合理,然後聯邦政府也直接做出停止旗下企業下廣告在 Meta 旗下產品的決策以應對 Meta 這種行為。

Google 則是預告 6 個月後將會下架,然後跟政府討論如果要配合法案 Google 的條件是什麼,因此被評論為相對能理解企業的考量。

--

我其實能明白乍看之下這個法案很不合理,怎麼會要求幫忙做流量的平台付錢給媒體,但這牽涉到媒體存亡的議題,且討論多年才立法,其實得回顧一下當初成立這個法案的脈絡。

1/3

SteamWorld Heist 是最近每天晚上睡前用 Deck 玩兩下的遊戲,很簡單易懂的機制,富有挑戰的策略,令人滿足的升級和裝備機制,以及非常具有特色的美術和音樂,尤其是常常可以到酒吧,去聽真人演唱的異國風情機器人樂曲。

至於介面和操作,完完全全就是設計給 deck 玩的無痛上手遊戲。我是沒想到特價台幣30元不到,可以讓我玩個 7+ 小時....

千言萬語不知道從何說起。

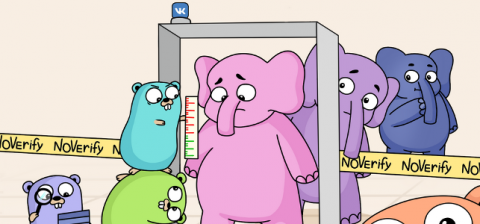

歷經一個月,測了五種 PHP static code analyzer ,都沒辦法輕鬆找到想要偵錯的類型。最後居然是意外從某個留言看到用「go」寫的 PHP linter:NoVerify,可以成功的跑出我想要跑的偵錯類型,這就算了,比起 PHP 的同類卡半天,他瞬間跑完,還是個挺烏克蘭的俄國人獨立寫完的。

其他的 Static Code Analyzer / linter,要不就是太陽春只看格式,要不就是太複雜結果根本跑不完,更別說還常碰到PHP本身的相容問題,原本寄望的另一個 Static Code Analyzer ( Psalm),剛剛卡在最後 100% 動不了,我都去吃完牛排五十分鐘過去回來還卡在那

最後誰想的到會有人用 go 寫 php-parser、要從 go 去找 PHP linter 啊... 然後專案的代表圖,PHP 大象們也太哀傷了吧。

為什麼中時總編會允許報導從這個角度出發啊,真稀奇,而且查了幾篇中韓分析,看起來都是同一個編輯署名整理的👍 。

但這一題這樣談,我查了半天,好像沒什麼外媒用 FTA + 貿易順逆差這種很單純的觀點去談因果,畢竟從 2015 年簽了之後還有一堆兩國衝突,例如中國報復韓國答應美國部署薩德飛彈,到後面產業競爭,和中日韓自由貿易等等,看現在一整個「韓國 FTA 導致失敗」的風向論述實在有點滑坡。

努力查一查, FTA + 薩德矛盾還真的有韓國人做了論文來驗證關聯性,可惜我只有權限讀摘要。該論文的摘要說 FTA 緩解了原本薩德帶來的中國消費抵制(影響韓國出口)。

https://www.tandfonline.com/doi/full/10.1080/10971475.2021.1930300中時摘要謝金河的文章,紀念一下

《中韓FTA糖衣變毒藥 老謝:南韓今羡慕台灣》

https://ctee.com.tw/news/global/849217.html